Erwartungswert

DerErwartungswert(selten und doppeldeutigMittelwert) ist ein Grundbegriff derStochastik.Der Erwartungswert ist eine Kennzahl einerZufallsvariablen.Bei einer engeren Definition ist der Erwartungswert einer Zufallsvariablen eine reelle Zahl und damit endlich; bei einer weiteren Definition sind für den Erwartungswert einer Zufallsvariablen auch die Wertezugelassen. Es gibt Zufallsvariablen, für die kein Erwartungswert definiert ist.

Hat eine Zufallsvariable einen endlichen Erwartungswert, so wird dieser häufig mitabgekürzt; er beschreibt dann die Zahl, die die Zufallsvariable im Mittel annimmt. Er ergibt sich zum Beispiel bei unbegrenzter Wiederholung des zugrunde liegendenExperimentsals Durchschnitt der Ergebnisse. DasGesetz der großen Zahlenbeschreibt, in welcher Form die Durchschnitte der Ergebnisse bei wachsender Anzahl der Experimente gegen den endlichen Erwartungswert streben, oder anders gesagt, wie dieStichprobenmittelwertebei wachsendem Stichprobenumfang gegen den Erwartungswertkonvergieren.

Ein endlicher Erwartungswert bestimmt dieLokalisation(Lage) derVerteilungder Zufallsvariablen und ist vergleichbar mit dem empirischenarithmetischen MitteleinerHäufigkeitsverteilungin derdeskriptiven Statistik,jedoch mit einem wichtigen Unterschied: Der Erwartungswert ist der„wahre “MittelwerteinerZufallsvariablen(Mittelwert derGrundgesamtheit), während sich das arithmetische Mittel in der Regel nur auf eineStichprobevon Werten bezieht (Stichprobenmittel). Eine neue Stichprobe wird einen unterschiedlichen arithmetischen Mittelwert liefern, jedoch bleibt der Erwartungswertimmer gleich.

Der Erwartungswert berechnet sich als nach der Wahrscheinlichkeit gewichtetes Mittel der Werte, die die Zufallsvariable annimmt. Er muss selbst jedoch nicht einer dieser Werte sein.

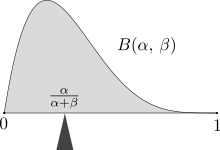

Weil der Erwartungswert einer Zufallsvariablen nur von derenWahrscheinlichkeitsverteilungabhängt, wird auch vom Erwartungswert einer Wahrscheinlichkeitsverteilung gesprochen, ohne Bezug auf eine Zufallsvariable. Der endliche Erwartungswert einer Zufallsvariablen kann als Schwerpunkt der Wahrscheinlichkeitsmasse betrachtet werden und wird daher als ihrerstes Momentbezeichnet.

Motivation

[Bearbeiten|Quelltext bearbeiten]Die Augenzahlen beim Würfelwurf können als unterschiedliche Ausprägungen einer Zufallsvariablenbetrachtet werden. Weil die (tatsächlich beobachteten) relativen Häufigkeiten sich gemäß demGesetz der großen Zahlenmit wachsendem Stichprobenumfangden theoretischen Wahrscheinlichkeiten der einzelnen Augenzahlen annähern, muss der Mittelwert gegen den Erwartungswert vonstreben. Zu dessen Berechnung werden die möglichen Ausprägungen mit ihrer theoretischen Wahrscheinlichkeit gewichtet.

Wie die Ergebnisse der Würfelwürfe ist der Mittelwert vomZufallabhängig. Im Unterschied dazu ist der Erwartungswert eine feste Kennzahl der Verteilung der Zufallsvariablen.

Die Definition des Erwartungswerts steht in Analogie zum gewichteten Mittelwert von empirisch beobachteten Zahlen. Hat zum Beispiel eine Serie von zehnWürfelversuchendie Ergebnisse 4, 2, 1, 3, 6, 3, 3, 1, 4, 5 geliefert, kann der zugehörige Mittelwert

alternativ berechnet werden, indem zunächst gleiche Werte zusammengefasst und nach ihrerrelativen Häufigkeitgewichtet werden:

- .

Allgemein lässt der Mittelwert der Augenzahlen inWürfen sich wie

schreiben, worindie relativeHäufigkeitder Augenzahlbezeichnet.

Begriff und Notation

[Bearbeiten|Quelltext bearbeiten]Begriff

[Bearbeiten|Quelltext bearbeiten]Das Konzept des Erwartungswertes geht aufChristiaan Huygenszurück. In einer Abhandlung über Glücksspiele von 1656 (Van rekeningh in spelen van geluck) beschreibt Huygens den erwarteten Gewinn eines Spiels als „het is my soo veel weerdt “(„es ist mir so viel wert “).Frans van Schootenverwendete in seiner Übersetzung von Huygens’ Text ins Lateinische den Begriffexpectatio(„Erwartung “).Bernoulliübernahm in seinerArs conjectandiden von van Schooten eingeführten Begriff in der Formvalor expectationis(„Erwartungswert “).[1]

Notation

[Bearbeiten|Quelltext bearbeiten]Das Symbol E fürErwartungswertoderExpectationwurde in der englischsprachigen Literatur erst ab dem 20. Jahrhundert eingeführt.[2] Heute wird in der englischsprachigen und deutschsprachigen mathematischen Literatur häufig die Schreibweiseoderoder auch mit eckigen Klammernbzw.für den Erwartungswert der Zufallsvariableverwendet.[3][4] Gelegentlich werden auch geschweifte Klammern verwendet.[5]

In der russischsprachigen Literatur findet sich die Bezeichnung.[6]

Gelegentlich werden auch die Klammern um die Zufallsvariable weggelassen, was der Schreibweise fürOperatorenentspricht:oder.[7]Mit der auch vorkommenden Notationbesteht hierbei nicht die Gefahr, dass der Operatormit einer Zufallsvariable verwechselt wird. Die Notationmit den eckigen Klammern hebt speziell die Tatsache hervor, dass es sich hier um einFunktionalhandelt.

Die Bezeichnungdes Erwartungswerts der Zufallsvariablebetont die Eigenschaft als nicht vom Zufall abhängiges erstes Moment. In der Physik findet dieBra-Ket-NotationVerwendung.[2] Insbesondere wirdstattfür den Erwartungswert einer Größegeschrieben.

Definitionen

[Bearbeiten|Quelltext bearbeiten]Ist eine Zufallsvariablediskretoder besitzt sie eineDichte,so existieren die folgenden Formeln für den Erwartungswert.

Erwartungswert einer diskreten reellen Zufallsvariable

[Bearbeiten|Quelltext bearbeiten]Im reellen diskreten Fall errechnet sich der Erwartungswert als dieSummederProdukteaus denWahrscheinlichkeitenjedes möglichen Ergebnisses des Experiments und den „Werten “dieser Ergebnisse.

Isteine reellediskrete Zufallsvariable,die die Wertemit den jeweiligen Wahrscheinlichkeitenannimmt (mitals abzählbarerIndexmenge), so errechnet sich der Erwartungswertim Falle der Existenz mit:

Es ist zu beachten, dass dabei nichts über die Reihenfolge der Summation ausgesagt wird (siehesummierbare Familie).

Ist,so besitztgenau dann einen endlichen Erwartungswert,wenn dieKonvergenzbedingung

- erfüllt ist, d. h. die Reihe für den Erwartungswertabsolut konvergentist.

Für nichtnegative ganzzahlige Zufallsvariablen ist oft die folgende Eigenschaft hilfreich[8]

Diese Eigenschaft wird im Abschnitt über den Erwartungswert einer nicht-negativen Zufallsvariablen bewiesen.

Erwartungswert einer reellen Zufallsvariable mit Dichtefunktion

[Bearbeiten|Quelltext bearbeiten]

Hat eine reelle ZufallsvariableeineWahrscheinlichkeitsdichtefunktion,das heißt hat dasBildmaßdieDichtebezüglich desLebesgue-Maßes,so berechnet sich der Erwartungswert im Falle der Existenz als

- (1)

In vielen Anwendungsfällen liegt (im Allgemeinenuneigentliche)Riemann-Integrierbarkeitvor und es gilt:

- (2)

Gleichwertig zu dieser Gleichung ist, wennVerteilungsfunktionvonist:

- (3)

(2) und (3) sind unter der gemeinsamen Voraussetzung (ist Dichtefunktion undist Verteilungsfunktion von) äquivalent, was mit schulgemäßen Mitteln bewiesen werden kann.[9]

Für nichtnegative Zufallsvariablen folgt daraus die wichtige Beziehung zurZuverlässigkeitsfunktion

Allgemeine Definition

[Bearbeiten|Quelltext bearbeiten]Der Erwartungswert wird entsprechend als dasLebesgue-Integralbezüglich desWahrscheinlichkeitsmaßesdefiniert: Isteine bezüglich dem Maßintegrierbare oderquasiintegrierbareZufallsvariable auf einemWahrscheinlichkeitsraummit Werten in,wobeidieBorelsche σ-Algebraüberist, so wird definiert

mit derWahrscheinlichkeitsverteilung.Die Zufallsvariablebesitzt genau dann einen Erwartungswert, wenn siequasiintegrierbarist, also die Integrale

- und

nicht beide unendlich sind, wobeiunddenPositiv- sowie den Negativteilvonbezeichnen. In diesem Fall kannodergelten.

Der Erwartungswert ist genau dann endlich, wennintegrierbar ist, also die obigen Integrale überundbeideendlich sind. Dies ist äquivalent mit

In diesem Fall schreiben viele Autoren, der Erwartungswertexistiereodersei eine Zufallsvariablemit existierendem Erwartungswert,und schließen damit den Fallbzw.aus.

Der (endliche) Erwartungswert einer reellen Zufallsvariablenkann aber auch am Graphen ihrerVerteilungsfunktiondurch eine naheliegende Flächengleichheit festgelegt werden. Es ist nämlichmit einer reellen Zahlgenau dann, wenn in der--Ebene die beiden Flächen, beschrieben durch

- bzw.

denselben endlichen Flächeninhalt haben, d. h. wenn

gilt und beideuneigentlichen Riemann-Integralekonvergieren. Dazu äquivalent ist die allgemeingültige Darstellung(3),ebenfalls mit konvergenten Integralen.[10]

Elementare Eigenschaften

[Bearbeiten|Quelltext bearbeiten]Linearität

[Bearbeiten|Quelltext bearbeiten]Der Erwartungswert istlinearfür Zufallsvariablen mit endlichem Erwartungswert. Es gilt also für beliebige, nicht notwendigerweise stochastisch unabhängige, Zufallsvariablenmit endlichen Erwartungswerten, dass

ist. Als Spezialfälle ergeben sich

- ,

und

- .

Die Linearität lässt sich auch auf endliche Summen erweitern:

Die Linearität des Erwartungswertes für Zufallsvariablen mit endlichem Erwartungswert folgt aus derLinearität des Integralsfür integrierbare Funktionen. Die Voraussetzung endlicher Erwartungswerte ist wesentlich für die Anwendung der Linearitätseigenschaft als Rechenregel. Beispielsweise ist es möglich, dassundund der Erwartungswert vonnicht definiert ist oder in anderen Fällen endlich ist.

Monotonie

[Bearbeiten|Quelltext bearbeiten]Existieren die Erwartungswerteund,so gilt

- .

Die Voraussetzung,d. h.für alle,lässt sich abschwächen zu,d. h.fast sicher.

Wahrscheinlichkeiten als Erwartungswerte

[Bearbeiten|Quelltext bearbeiten]Wahrscheinlichkeiten vonEreignissenlassen sich auch über den Erwartungswert ausdrücken. Für jedes Ereignisgilt

- ,

wobeidieIndikatorfunktionvonist.

Dieser Zusammenhang ist oft nützlich, etwa zum Beweis derTschebyschow-Ungleichung.

Dreiecksungleichung

[Bearbeiten|Quelltext bearbeiten]Es gilt

und

- .

Beispiele

[Bearbeiten|Quelltext bearbeiten]Würfeln

[Bearbeiten|Quelltext bearbeiten]

Das Experiment sei einWürfelwurf.Als Zufallsvariablebetrachten wir die gewürfelte Augenzahl, wobei jede der Zahlen 1 bis 6 mit einer Wahrscheinlichkeit von jeweils 1/6 gewürfelt wird.

Wenn beispielsweise 1000-mal gewürfelt wird, man also das Zufallsexperiment 1000-mal wiederholt und die geworfenen Augenzahlen zusammenzählt und durch 1000 dividiert, ergibt sich mit hoher Wahrscheinlichkeit ein Wert in der Nähe von 3,5. Es ist jedoch unmöglich, diesen Wert mit einem einzigen Würfelwurf zu erzielen.

Sankt-Petersburg-Paradoxon

[Bearbeiten|Quelltext bearbeiten]DasSankt-Petersburg-Paradoxonbeschreibt ein Glücksspiel, dessen zufälliger Gewinneinen unendlichen Erwartungswert hat. Gemäß der klassischen Entscheidungstheorie, die auf derErwartungswertregelbasiert, sollte man daher einen beliebig hohen Einsatz riskieren. Da die Wahrscheinlichkeit für einen Verlust des Einsatzes aberbeträgt, erscheint diese Empfehlung nicht rational. Eine Lösung des Paradoxons stellt die Verwendung einer logarithmischenNutzenfunktiondar.

Zufallsvariable mit Dichte

[Bearbeiten|Quelltext bearbeiten]Gegeben ist die reelle Zufallsvariablemit der Dichtefunktion

wobeidie Eulersche Konstante bezeichnet.

Der Erwartungswert vonberechnet sich als

Allgemeine Definition

[Bearbeiten|Quelltext bearbeiten]Gegeben sei der Wahrscheinlichkeitsraummit,diePotenzmengevonundfür.Der Erwartungswert der Zufallsvariablenmitundist

Daeine diskrete Zufallsvariable ist mitund,kann der Erwartungswert alternativ auch berechnet werden als

Weitere Eigenschaften

[Bearbeiten|Quelltext bearbeiten]Erwartungswert einer nicht-negativen Zufallsvariable

[Bearbeiten|Quelltext bearbeiten]Fallsist undfast sicher nicht-negativ ist, so gilt gemäß demSatz von Fubini-Tonelli(hierbei bezeichnen die eckigen Klammern diePrädikatabbildung)

Also ist

(Die letzte Gleichheit ist richtig, dafür fast alle.)

Fürergibt sich der folgende bekannte Spezialfall:

Für ganzzahlige, nichtnegative Zufallsvariablen gilt also wegen

die oben genannte Formel:

Sigma-Additivität

[Bearbeiten|Quelltext bearbeiten]Sind alle Zufallsvariablenfast sicher nichtnegativ, so lässt sich die endliche Additivität sogar zur-Additivität erweitern:

Erwartungswert des Produkts vonnstochastisch unabhängigen Zufallsvariablen

[Bearbeiten|Quelltext bearbeiten]Wenn die Zufallsvariablenstochastisch unabhängigsind und endliche Erwartungswerte besitzen (integrierbar sind), dann hat auch das Produkteinen endlichen Erwartungswert und es gilt

- .

Insbesondere gilt auch

- für.

Wenn die Zufallsvariablenstochastisch unabhängig sind und die Zufallsvariablenendliche Erwartungswerte besitzen, dann hat auch das Produkteinen endlichen Erwartungswert und es gilt

- .[11]

Die Voraussetzung endlicher Erwartungswerte ist wesentlich. Wenn beispielsweise zwei stochastisch unabhängige Zufallsvariablenunddie Erwartungswerteundhaben, dann ist es möglich, dassnicht definiert ist. Die Zufallsvariablebesitze eineStandard-Cauchy-Verteilung,dann istnicht definiert. Andererseits giltmit,,wobeiundstochastisch unabhängig sind mit den Erwartungswertenund.

Erwartungswert des Produkts von nicht stochastisch unabhängigen Zufallsvariablen

[Bearbeiten|Quelltext bearbeiten]Falls die Zufallsvariablenundnicht stochastisch unabhängig sind, gilt für deren Produkt:

Dabei istdieKovarianzzwischenund.

Erwartungswert einer zusammengesetzten Zufallsvariable

[Bearbeiten|Quelltext bearbeiten]Isteine zusammengesetzte Zufallsvariable, sprich sindunabhängige Zufallsvariablen und sind dieidentisch verteilt und istaufdefiniert, so lässt sichdarstellen als

- .

Existieren die ersten Momente von,so gilt

- .

Diese Aussage ist auch alsFormel von Waldbekannt. Sie wird z. B. in derSchadensversicherungsmathematikbenutzt.

Monotone Konvergenz

[Bearbeiten|Quelltext bearbeiten]Sind die nichtnegativen Zufallsvariablenfast sicher punktweise monoton wachsend undkonvergieren fast sichergegen eine weitere Zufallsvariable,so gilt

- .

Dies ist derSatz von der monotonen Konvergenzin der wahrscheinlichkeitstheoretischen Formulierung.

Berechnung mittels der kumulantenerzeugenden Funktion

[Bearbeiten|Quelltext bearbeiten]Diekumulantenerzeugende Funktioneiner Zufallsvariable ist definiert als

- .

Wird sie abgeleitet und an der Stelle 0 ausgewertet, so ist der Erwartungswert:

- .

Die ersteKumulanteist also der Erwartungswert.

Berechnung mittels der charakteristischen Funktion

[Bearbeiten|Quelltext bearbeiten]Diecharakteristische Funktioneiner Zufallsvariableist definiert als. Mit ihrer Hilfe lässt sich durch Ableiten der Erwartungswert der Zufallsvariable bestimmen:

- .

Berechnung mittels der momenterzeugenden Funktion

[Bearbeiten|Quelltext bearbeiten]Ähnlich wie die charakteristische Funktion ist diemomenterzeugende Funktiondefiniert als

- .

Auch hier lässt sich der Erwartungswert einfach bestimmen als

- .

Dies folgt daraus, dass der Erwartungswert das erste Moment ist und die k-ten Ableitungen der momenterzeugenden Funktion an der 0 genau die k-ten Momente sind.

Berechnung mittels der wahrscheinlichkeitserzeugenden Funktion

[Bearbeiten|Quelltext bearbeiten]Wennnur natürliche Zahlen als Werte annimmt, lässt sich der Erwartungswert fürauch mithilfe derwahrscheinlichkeitserzeugenden Funktion

- .

berechnen. Es gilt dann

- ,

falls derlinksseitige Grenzwertexistiert.

Beste Approximation

[Bearbeiten|Quelltext bearbeiten]Isteine Zufallsgröße auf einemWahrscheinlichkeitsraum,so beschreibtdie beste Approximation anim Sinne der Minimierung von,wobeiaeine reelle Konstante ist. Dies folgt aus dem Satz über die beste Approximation, da

für alle konstantenist, wobeidas-Standardnormalskalarproduktbezeichne. Diese Auffassung des Erwartungswertes macht die Definition derVarianzals minimalermittlerer quadratischer Abstandsinnvoll, siehe auchFréchet-Prinzip.

Erwartungswerte von Funktionen von Zufallsvariablen

[Bearbeiten|Quelltext bearbeiten]Funktion einer Zufallsvariablen

[Bearbeiten|Quelltext bearbeiten]sei eine stetige Zufallsvariable mit der Dichtefunktion. Wennwieder eine Zufallsvariable ist, so kann der Erwartungswert vonauf zwei Arten bestimmt werden. Entweder kann über den Zusammenhangdie Wahrscheinlichkeitsverteilung vonbestimmt und dann die Definition des Erwartungswertes verwendet werde, oder aber – und dies ist häufig einfacher – es wird die Formel

verwendet. Dieser Erwartungswert ist endlich, falls

endlich ist.

Bei einer diskreten Zufallsvariablenmit der Wahrscheinlichkeitsfunktionwird die Summe

verwendet. Enthält die Summe unendlich viele Summanden, dann muss die Reiheabsolut konvergieren,damit der Erwartungswert endlich ist.

Im allgemeinen Fall einer Zufallsvariablenmit der Verteilungsfunktionkann der Erwartungswert mit Hilfe des Lebesgue-Stieltjes-Integral als

bestimmt werden.ist endlich, fallsendlich ist. Falls mindestens einer der nichtnegativen Erwartungswerteundendlich ist, ist=,anderenfalls istnicht definiert. Falls nicht nur endliche Erwartungswerte interessieren, müssen analoge Fallunterscheidungen auch für die Fälle einer stetigen oder diskreten Zufallsvariable vorgenommen werden, d. h. die positiven und die negativen Werte vonmüssen getrennt ausgewertet werden.

Funktion von zwei Zufallsvariablen mit gemeinsamer Dichtefunktion

[Bearbeiten|Quelltext bearbeiten]Haben die integrierbaren Zufallsvariablenundeine gemeinsameWahrscheinlichkeitsdichtefunktion,so kann der Erwartungswert einer Funktionvonundnach demSatz von Fubini,wenn dessen Voraussetzungen erfüllt sind, wenn alsoendlich ist oder wennnichtnegativ ist, als

berechnet werden. Der Erwartungswert vonist nur dann endlich, wenn das Integral

endlich ist.

Insbesondere ist:

Aus der Randdichte errechnet sich der Erwartungswert wie bei univariaten Verteilungen:

Dabei ist die Randdichtegegeben durch

Verwandte Konzepte und Verallgemeinerungen

[Bearbeiten|Quelltext bearbeiten]Lageparameter

[Bearbeiten|Quelltext bearbeiten]Wird der Erwartungswert als Schwerpunkt der Verteilung einer Zufallsvariable aufgefasst, so handelt es sich um einen Lageparameter. Dieser gibt an, wo sich der Hauptteil der Verteilung befindet. Weitere Lageparameter sind

- derModus:Der Modus gibt an, an welcher Stelle die Verteilung ein Maximum hat, sprich bei diskreten Zufallsvariablen die Ausprägung mit der größten Wahrscheinlichkeit und bei stetigen Zufallsvariable die Maximastellen der Dichtefunktion. Der Modus existiert zwar im Gegensatz zum Erwartungswert immer, muss aber nicht eindeutig sein. Beispiele für nichteindeutige Modi sindbimodale Verteilungen.

- derMedianist ein weiterer gebräuchlicher Lageparameter (in einerSkizze obenmitgekennzeichnet). Er gibt an, welcher Wert auf der x-Achse die Wahrscheinlichkeitsdichte so trennt, dass links und rechts des Medians jeweils die Hälfte der Wahrscheinlichkeit anzutreffen ist. Auch der Median existiert immer, muss aber (je nach Definition) nicht eindeutig sein.

Momente

[Bearbeiten|Quelltext bearbeiten]Wird der Erwartungswert alserstes Momentaufgefasst, so ist er eng verwandt mit den Momenten höherer Ordnung. Da diese wiederum durch den Erwartungswert in Verknüpfung mit einer Funktiondefiniert werden, sind sie gleichsam ein Spezialfall. Einige der bekannten Momente sind:

- DieVarianz:Zentrierteszweites Moment,.Hierbei istder Erwartungswert.

- DieSchiefe:Zentriertes drittes Moment, normiert auf die dritte Potenz derStandardabweichung.Es ist.

- DieWölbung:Zentriertes viertes Moment, normiert auf.Es ist.

Bedingter Erwartungswert

[Bearbeiten|Quelltext bearbeiten]Derbedingte Erwartungswertist eine Verallgemeinerung des Erwartungswertes auf den Fall, dass gewisse Ausgänge des Zufallsexperiments bereits bekannt sind. Damit lassen sichbedingte Wahrscheinlichkeitenverallgemeinern und auch diebedingte Varianzdefinieren. Der bedingte Erwartungswert spielt eine wichtige Rolle in der Theorie derstochastischen Prozesse.

Quantenmechanischer Erwartungswert

[Bearbeiten|Quelltext bearbeiten]IstdieWellenfunktioneines Teilchens in einem bestimmtenZustandund istein Operator, so ist

der quantenmechanischeErwartungswertvonim Zustand. ist hierbei der Ortsraum, in dem sich das Teilchen bewegt,ist die Dimension von,und ein hochgestellter Stern steht fürkomplexeKonjugation.

Lässt sichals formalePotenzreiheschreiben (und das ist oft so), so wird die Formel verwendet

Der Index an der Erwartungswertsklammer wird nicht nur wie hier abgekürzt, sondern manchmal auch ganz weggelassen.

- Beispiel

Der Erwartungswert des Aufenthaltsorts in Ortsdarstellung ist

Der Erwartungswert des Aufenthaltsorts in Impulsdarstellung ist

wobei wir die Wahrscheinlichkeitsdichtefunktion der Quantenmechanik im Ortsraum identifiziert haben.

Erwartungswert von Matrizen und Vektoren

[Bearbeiten|Quelltext bearbeiten]Seieine stochastische-Matrix,mit den stochastischen Variablenals Elementen, dann ist der Erwartungswert vondefiniert als:

- .

Falls ein-Zufallsvektorvorliegt, gilt:

- .

Siehe auch

[Bearbeiten|Quelltext bearbeiten]Literatur

[Bearbeiten|Quelltext bearbeiten]- Krishna B. Athreya,Soumendra N. Lahiri:Measure Theory and Probability Theory(=Springer Texts in Statistics). Springer, New York NY u. a. 2006,ISBN 0-387-32903-X(MR2247694).

- Heinz Bauer:Wahrscheinlichkeitstheorie(=De Gruyter Lehrbuch). 5., durchgesehene und verbesserte Auflage. de Gruyter, Berlin u. a. 2002,ISBN 3-11-017236-4(MR1902050).

- Kai Lai Chung:A Course in Probability Theory.3. Auflage. Academic Press, San Diego CA u. a. 2001,ISBN 0-12-174151-6(R1796326).

- Walter Greiner:Quantenmechanik.6. überarbeitete und erweiterte Auflage. Deutsch, Frankfurt am Main 2005,ISBN 3-8171-1765-5.

- Erich Härtter:Wahrscheinlichkeitsrechnung für Wirtschafts- und Naturwissenschaftler(=Uni-Taschenbücher.Nr.409). Vandenhoeck & Ruprecht, Göttingen 1974,ISBN 3-525-03114-9.

- Norbert Henze:Stochastik für Einsteiger. Eine Einführung in die faszinierende Welt des Zufalls.10., überarbeitete Auflage. Springer Spektrum, Wiesbaden 2013,ISBN 978-3-658-03076-6.

- Achim Klenke:Wahrscheinlichkeitstheorie.3., überarbeitete und ergänzte Auflage. Springer Spektrum, Berlin u. a. 2013,ISBN 978-3-642-36017-6.

- Norbert Kusolitsch:Maß- und Wahrscheinlichkeitstheorie. Eine Einführung(=Springer-Lehrbuch). 2., überarbeitete und erweiterte Auflage. Springer Spektrum, Heidelberg u. a. 2014,ISBN 978-3-642-45386-1.

- Michel Loève:Probability Theory I(=Graduate Texts in Mathematics.Band45). 4. Auflage. Springer Verlag, New York NY u. a. 1977,ISBN 3-540-90210-4(MR0651017).

- Vladimir Spokoiny,Thorsten Dickhaus:Basics of Modern Mathematical Statistics(=Springer Texts in Statistics). Springer, Heidelberg u. a. 2015,ISBN 978-3-642-39908-4(MR3289985).

Einzelnachweise

[Bearbeiten|Quelltext bearbeiten]- ↑Norbert Henze:Stochastik für Einsteiger. Eine Einführung in die faszinierende Welt des Zufalls.7., überarbeitete und erweiterte Auflage. Vieweg + Teubner, Wiesbaden 2008,ISBN 978-3-8348-0423-5,S. 79.

- ↑abJohn Aldrich:Earliest Uses of Symbols in Probability and Statistics.2014, (online).

- ↑Baden-Württembergische Lehrerinnen verwenden die Schreibweise.

- ↑David Meintrup,Stefan Schäffler:Stochastik. Theorie und Anwendungen.Springer, Berlin u. a. 2005,ISBN 3-540-21676-6.

- ↑Eugen-Georg Woschni:Informationstechnik. Signal, System, Information.2., bearbeitete Auflage. Verlag Technik, Berlin 1981.

- ↑Siehe etwa (in deutscher Übersetzung)Albert N. Širjaev:Wahrscheinlichkeit(=Hochschulbücher für Mathematik.91). Deutscher Verlag der Wissenschaften, Berlin 1988,ISBN 3-326-00195-9,S. 52 ff.

- ↑SieheIlja N. Bronstein,Konstantin A. Semendjajew:Taschenbuch der Mathematik.23. Auflage. Deutsch, Thun u. a. 1987,ISBN 3-87144-492-8.Der Operator wird hier kursiv gesetzt.

- ↑Sheldon M. Ross:Introduction to probability models.9. Auflage. Academic Press, Amsterdam u. a. 2007,ISBN 978-0-12-598062-3,S. 143.

- ↑Helmut Wirths:Der Erwartungswert. Skizzen zur Begriffsentwicklung von Klasse 8 bis 13.In:Mathematik in der Schule.Band 33, Heft 6, 1995, S. 330–343.

- ↑Roland Uhl:Charakterisierung des Erwartungswertes am Graphen der Verteilungsfunktion.Technische Hochschule Brandenburg, 2023,doi:10.25933/opus4-2986(PDF). S. 2–4.

- ↑Galen R. Shorack:Probability for Statisticians(=Springer Texts in Statistics). 2. Auflage. Springer, Cham 2017,ISBN 978-3-319-52206-7,S.128,Theorem 1.1,doi:10.1007/978-3-319-52207-4.

![{\displaystyle \operatorname {E} \left[X\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2c7c7e2b2e9678ed25445dcedd76f63605d08107)

![{\displaystyle \mathbb {E} \left[X\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0da88481bc3637feba360a17031ef10deed2c4f2)

![{\displaystyle {\begin{aligned}\operatorname {E} (X)&=\int _{-\infty }^{\infty }xf(x)\,\mathrm {d} x=\int _{-\infty }^{3}x\cdot 0\,\mathrm {d} x+\int _{3}^{3\mathrm {e} }x\cdot {\frac {1}{x}}\,\mathrm {d} x+\int _{3\mathrm {e} }^{\infty }x\cdot 0\,\mathrm {d} x\\&=0+\int _{3}^{3\mathrm {e} }1\,\mathrm {d} x+0=[x]_{3}^{3\mathrm {e} }=3\mathrm {e} -3=3(\mathrm {e} -1).\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/90e78ff16b7f7cba0d4b5963e2be75a268f98bad)

![{\displaystyle \operatorname {E} (X^{p})=\int _{\Omega }X(\omega )^{p}\,\mathrm {d} P(\omega )=\int _{\Omega }\int _{0}^{\infty }px^{p-1}[x\leq X(\omega )]\,\mathrm {d} x\,\mathrm {d} P(\omega )=\int _{0}^{\infty }\int _{\Omega }px^{p-1}[x\leq X(\omega )]\,\mathrm {d} P(\omega )\,\mathrm {d} x=p\int _{0}^{\infty }x^{p-1}P{\big (}\{\omega \in \Omega \mid x\leq X(\omega )\}{\big )}\,\mathrm {d} x}](https://wikimedia.org/api/rest_v1/media/math/render/svg/20983c220e287a56e89b8e7dbb2a57af8d57fece)

![{\displaystyle \operatorname {E} \left[X\right]=\lim _{t\uparrow 1}m_{X}'(t)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/abf6eda3ba4f4d1c360c1ec6c97a8cfce55d4194)