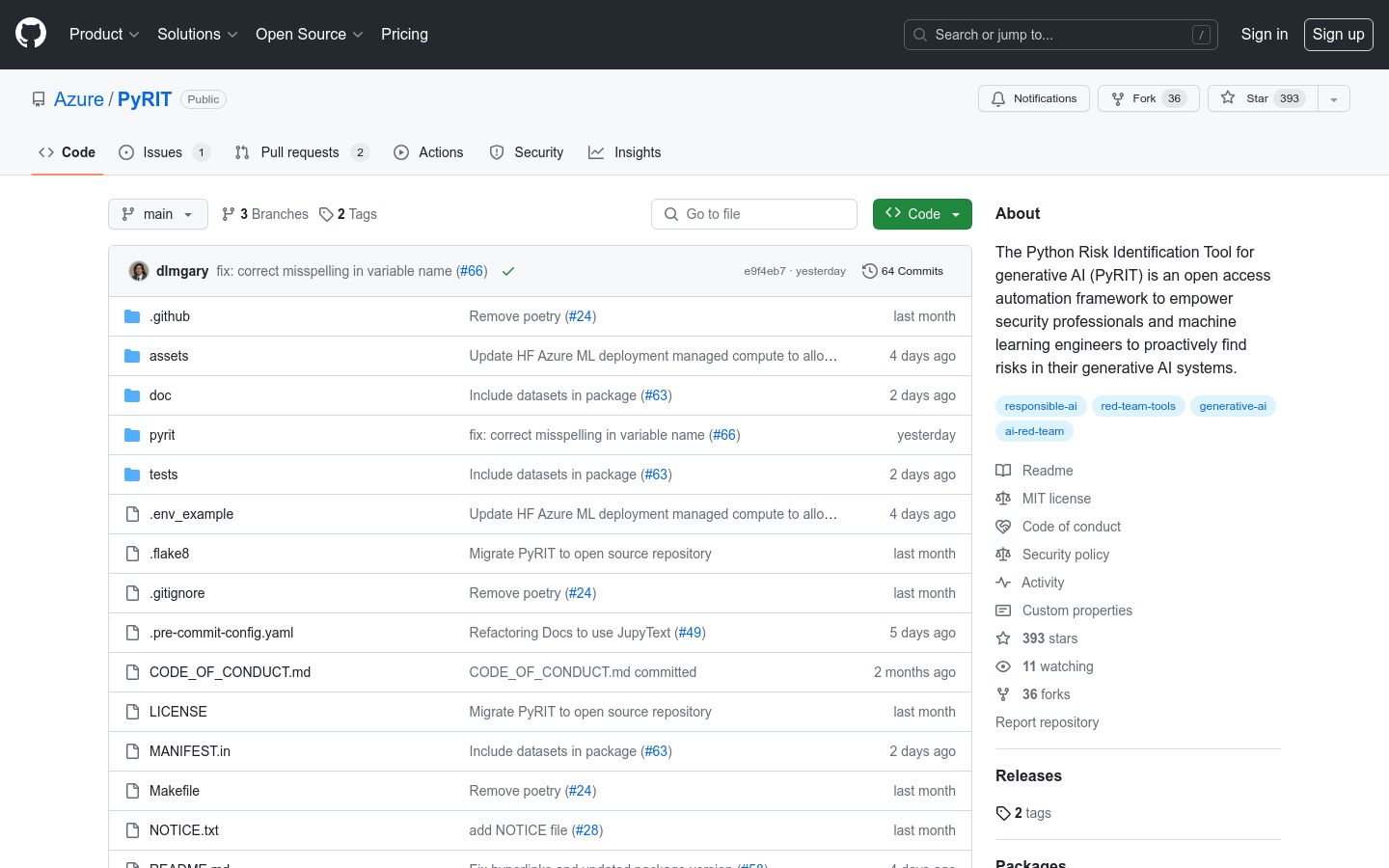

PyRIT是由Azure开发的Python风险识别工具,旨在帮助安全专业人员和机器学习工程师主动发现其生成AI系统中的风险。该工具自动化了AI红队任务,使操作者能够专注于更复杂和耗时的任务,同时能够识别安全和隐私危害。

需求人群:

["AI系统安全评估","机器学习模型健壮性测试","生成AI应用风险管理"]

使用场景示例:

在AI聊天机器人开发中使用PyRIT检测潜在的偏见和不当内容

利用PyRIT对AI图像生成模型进行安全测试,防止生成有害图像

在AI模型部署前,使用PyRIT进行风险评估,确保模型的合规性和安全性

产品特色:

自动化AI红队任务

风险识别与评估

安全和隐私危害检测

浏览量:45

最新流量情况

月访问量

4.89m

平均访问时长

00:06:37

每次访问页数

5.70

跳出率

37.28%

流量来源

直接访问

52.59%

自然搜索

32.74%

邮件

0.05%

外链引荐

12.33%

社交媒体

2.17%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.61%

德国

3.57%

印度

9.68%

俄罗斯

4.81%

美国

18.94%

生成AI风险识别自动化框架

PyRIT是由Azure开发的Python风险识别工具,旨在帮助安全专业人员和机器学习工程师主动发现其生成AI系统中的风险。该工具自动化了AI红队任务,使操作者能够专注于更复杂和耗时的任务,同时能够识别安全和隐私危害。

AI安全防护平台,全面管理AI风险

Protect AI是一个专注于AI安全的综合性平台,提供从端到端的AI安全风险管理和防护措施。它通过AI安全态势管理(AI-SPM)整合,帮助企业实现AI应用的安全性,同时保障数据安全和抵御AI特有的安全威胁。该平台能够为AI系统提供全面的可见性、修复和治理,支持企业在AI探索和创新中保持信心。

探索大型语言和视觉语言模型的漏洞与防护

JailbreakZoo是一个专注于破解大型模型(包括大型语言模型和视觉语言模型)的资源库。该项目旨在探索这些高级AI模型的漏洞、利用方法和防御机制,目的是促进对大规模AI系统安全方面的更深入理解和认识。

DeepMind推出的AI安全框架,旨在识别和减轻高级AI模型的未来风险。

Frontier Safety Framework是Google DeepMind提出的一套协议,用于主动识别未来AI能力可能导致严重伤害的情况,并建立机制来检测和减轻这些风险。该框架专注于模型层面的强大能力,如卓越的代理能力或复杂的网络能力。它旨在补充我们的对齐研究,即训练模型按照人类价值观和社会目标行事,以及Google现有的AI责任和安全实践。

智能商业报告生成器

StarterBuild的商业报告可以帮助您做出更明智的决策,节省宝贵的资源,并加快成功的步伐。报告提供可行的策略,包括风险和解决方案、盈利策略、用户画像、市场规模、品牌定位等。主要功能包括:风险和解决方案识别、盈利策略、用户画像、品牌定位、市场规模、功能规划、人工智能、定制报告等。

AI安全、美术、音乐等多种工具,赋能行业,让创作更简单

行者AI提供多种工具,包括AI安全、美术、音乐等,赋能行业,让创作更简单。其中包括内容风控、游戏风控、解决方案、智能反灰、产云短信、信息认证、人工审核、AI绘图创作、AI模型训练、二次元转化、ICON生成、3D减面、2D转3D、场景切换等功能。产品定位为提供专业内容与业务安全服务,赋能行业,让艺术创作更简单。产品定价根据不同功能点而定。

© 2024 AIbase 备案号:闽ICP备08105208号-14